1. Mai 2026 · Campus

Capstone-Projekt 2025/26: KI als Assistenzsystem für militärische Führung

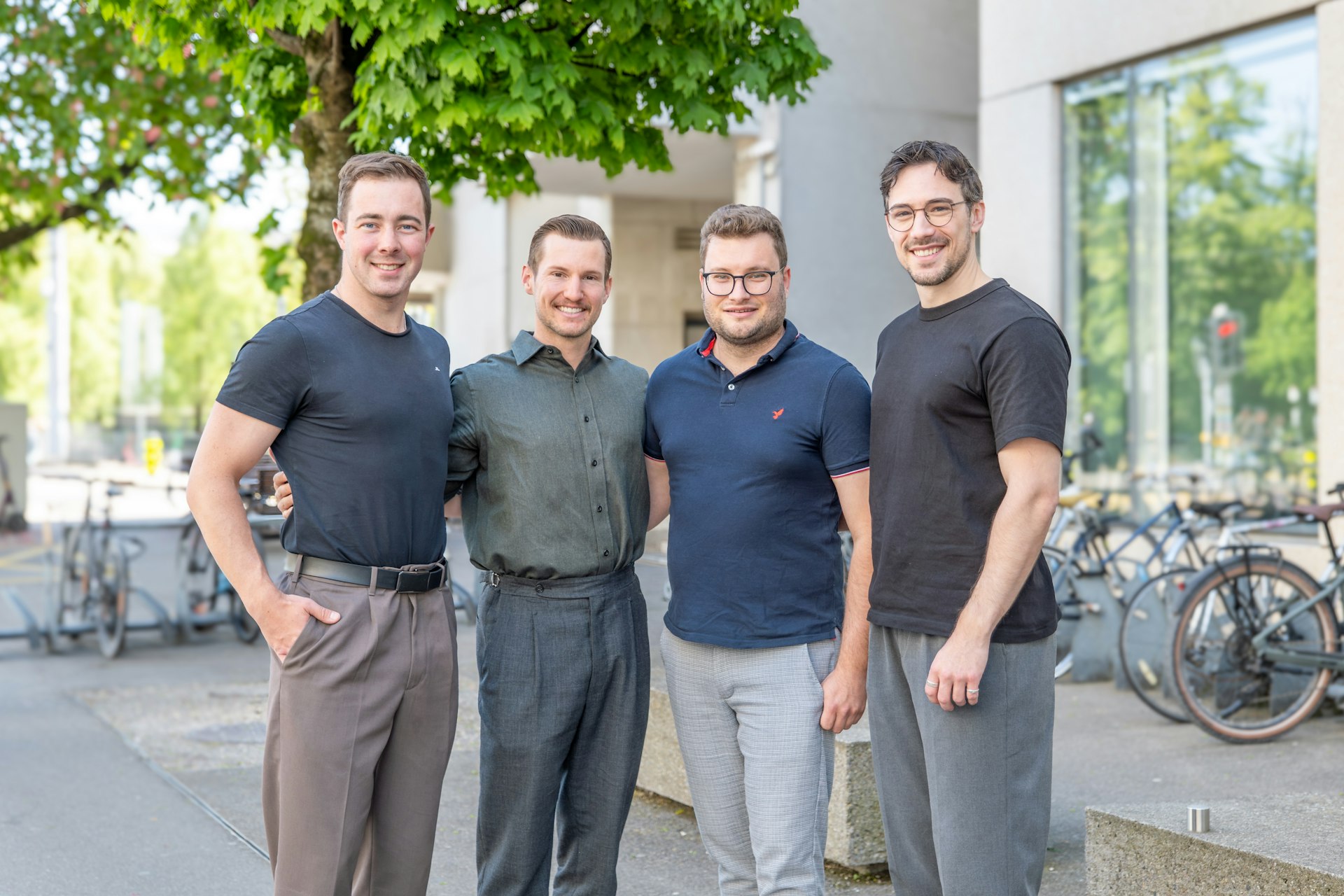

Wenn Entscheidungen in hoher Verantwortung unter Zeitdruck getroffen werden müssen und die Informationslage unvollständig ist, wird Führung zur Herausforderung. Genau hier setzt das Capstone-Projekt 2025/26 «SITRA» an: Robin Stalder, Laurent Schürch, Stefan Zellweger und Lars Müller, Studierende des Majors Digital Business & AI Management im Bachelor Betriebsökonomie HWZ, haben ein Konzept für ein KI-gestütztes Assistenzsystem entwickelt, das militärische Führungskräfte in dieser Problematik unterstützt, ohne ihnen die Entscheidung abzunehmen.

Über den Award

Der Bachelorstudiengang Business Administration HWZ freut sich, auch dieses Jahr das eindrückliche Resultat des diesjährigen Capstone-Projekts im Bachelor Betriebsökonomie bekannt zu geben. Der Studiengang wird mit dem Major Digital Business & AI Management HWZ abgeschlossen. Hierbei sind die Studierenden aufgefordert, einen Business Case für die Implementierung von Künstlicher Intelligenz in einem Unternehmen zu erstellen. Das beste Projekt wird jeweils mit einem renommierten Award ausgezeichnet.

Führung unter Unsicherheit als Ausgangspunkt

Die Idee für das Projekt entstand nicht im Theorieunterricht, sondern direkt aus der Praxis. Robin Stalder, Milizoffizier im Grad Oberleutnant, in Ausbildung zum Kompaniekommandanten, und Lars Müller, Wachtmeister in der Funktion eines Übermittlers, erleben militärische Führungsrealität regelmässig selbst.

Beide beobachten in Übungen und Einsätzen, dass Führungskräfte häufig unter extremem Zeitdruck mit unvollständigen, verzögerten oder widersprüchlichen Lageinformationen arbeiten müssen. In zeitkritischen militärischen Lagen müssen Informationen schnell, konsistent und nachvollziehbar verarbeitet werden. Sie werden entlang hierarchischer Stufen meist mündlich weitergegeben, gefiltert und interpretiert, wobei mit jedem Schritt das Risiko von Hör-, Schreib- und Interpretationsfehlern steigt. Am Ende erhält die entscheidende Führungsperson ein fragmentiertes und bereits gefiltertes Lagebild, auf dessen Basis dennoch wichtige Entscheidungen getroffen werden müssen.

Das Ziel: bessere Entscheidungen, nicht automatisierte Führung

So entwickelten sie als Capstone-Projekt mit «SITRA» eine KI-gestützte Lösung, die Informationen strukturiert zusammenführt und Führungskräfte gezielt entlastet. Das Ziel des Projekts war bewusst klar abgegrenzt: Nicht die Automatisierung von Führung, sondern die gezielte und messbare Verbesserung von Reaktionsfähigkeit, Lagekonsistenz und Entscheidungsqualität durch ein strukturiertes, technisch unterstütztes Lageführungssystem.

Konkret wollten sie zeigen, dass KI verantwortungsvoll und sicher in einem sicherheitskritischen Umfeld eingesetzt werden kann. Die Entscheidungshoheit sollte zu jedem Zeitpunkt vollständig bei der militärischen Führung verbleiben. Dabei haben sie mit einer sorgfältigen Problemanalyse und Beurteilung der Lage begonnen, wobei folgende Teilprobleme im Zentrum standen: Welche Schritte im Lageführungsprozess sind besonders fehleranfällig? Wo entsteht der grösste kognitive Aufwand? Erst dann haben sie mit der Architekturentwicklung begonnen.

Ihr Vorgehen war bewusst modular und iterativ. Sie haben in vier Projektphasen gearbeitet; von der Mandatsklärung über die Szenarienentwicklung, bis hin zur Erstellung eines Konzepts für die Erschaffung erster Prototypen. Dabei haben sie technisches Know-how aus dem Studium mit operativem Militärwissen kombiniert und beides konsequent auf das Nutzererlebnis der Führungskräfte ausgerichtet.

Die Lösung: «SITRA»

Die konzipierte Lösung trägt den Namen SITRA – Situational Tracking & Review Assistant. Es handelt sich um ein lokal betriebenes, sprachbasiertes Lageassistenzsystem, welches die militärische Führung gezielt unterstützt.

Im Zentrum steht ein sogenanntes «World Model», eine regelbasierte, einheitliche Informationsbasis, die als «Single Source of Truth» den aktuellen Lagezustand abbildet. Alle Beteiligten greifen auf dieselbe, geprüfte Grundlage zu.

Sprachbefehle werden zunächst per automatischer Spracherkennung (ASR) erfasst, dann durch ein LLM-basiertes Sprachverständnismodul interpretiert und schliesslich durch ein deterministisches Governance Gate geprüft, bevor sie als Zustandsänderung ins World Model übernommen werden. Trotz KI-Unterstützung bleibt der Mensch dabei jederzeit «in the loop». Zusätzlich protokolliert ein unveränderliches Event Log alle Aktionen für spätere Nachbearbeitungen (After Action Review).

Die grössten Herausforderungen

Die grösste Herausforderung war die Frage, wie viel KI-Autonomie die vier Studierenden in einem sicherheitskritischen System zulassen können und wollen.

Während vollautomatische Systeme technisch einfacher umzusetzen wären, lag die eigentliche Schwierigkeit darin, die richtige Balance zwischen KI-Unterstützung und menschlicher Kontrolle zu finden und diese Grenze klar zu definieren.

Gleichzeitig müssen sie sicherstellen, dass das System auch in Offline-Umgebungen funktioniert, was erhebliche Anforderungen an die lokale Verarbeitung stellt.

Eine weitere Herausforderung ist die Akzeptanz: Führungskräfte, die klassische Führungsprozesse gewohnt sind, müssen von einem neuen System überzeugt werden, ohne dass dieses ihre Autorität und Entscheidungsfreiheit in Frage stellt.

Learnings aus dem Studium

Das Studium hat uns in mehreren Hinsichten auf das Projekt vorbereitet. Die technischen Grundlagen zu KI, Natural Language Processing und Systemarchitektur konnten die Studierenden direkt anwenden – insbesondere bei der Konzeption des LLM-basierten NLU-Moduls und der deterministischen State Engine.

Das Change Management- und Value-Design-Know-how war entscheidend, um die Lösung nicht nur technisch, sondern auch aus Nutzerperspektive zu entwickeln. Schliesslich hat uns das Studium gelehrt, komplexe Probleme strukturiert anzugehen.

Das grösste Learning aus dem Projekt:

Verantwortungsvoller KI-Einsatz erfordert mehr Designaufwand als vollständige Automatisierung. Es ist einfacher, eine KI alles entscheiden zu lassen, anstelle es als Assistenzsystem mit gegebenen Grenzen zu implementieren. Gerade in sicherheitskritischen Kontexten muss der Mensch in der Lage sein, Systemvorschläge zu verstehen, zu hinterfragen und abzulehnen.

Diese Erkenntnis ist nicht nur im militärischen Umfeld relevant, sondern auch für viele andere Anwendungen kritischer KI-Systeme.

Wie geht es mit dem Projekt weiter?

Das Projekt wird in Zusammenarbeit mit den Swiss Innovation Forces der Schweizer Armee vorangetrieben. In dem fünf-stufigen Prozess ist der Idealisierungsteil abgeschlossen und übergeht nun in die Validierungsphase. Sollte die Machbarkeit des Projekts durch den Einsatz von Prototypen und Spezialisten Interviews als umsetzbar und mehrwertgenerierend eingestuft werden, so geht es in die Experimentierphase.